Tema: ¿ seria posible un eye-tracking en Morpheus?

Mensajes

-

Hablo desde la ignorancia.

Eso solucionaría sus grandes problemas de rendimiento ¿no?

-

Pues si consiguen el tracking ese de muy buena calidad del que hablaba johan anderson, yo creo que sería viable. Otra cosa es el precio que cueste ese y lo que valga al final el HMD.

I7 6700K / MSI 1070 Gaming X / MSI Z170 Gaming M5 / 16GB RAM DDR4 3000Mhz / Aerocool X-Strike 800W Gold

-

Si Sony consiguese el eye tracking y el foveated rendering y OR no lo trajese , partía por la mitad a Oculus . La ventaja de tener eso es tremenda . Imaginaros Oculus con su pantalla 2,5k a 95 Hz y a Sony con un cacharro a la misma resolucion pero que pide 4 o 5 veces menos maquina . O peor , un producto incluso de mas resolucion y pidiendo una maquina 3 veces inferior a la que pide el OR para correr un juego con la misma calidad . Sony o otro fabricante . Ese HMD rompe el mercado si el precio es parecido .

Incluso el foveated rendering, si disminuye el el ancho de banda necesario, podria dar pie a un modelo inalambrico a alta resolucion . Por todo esto pienso que el eye traking es un punto clave del futuro de estos HMD . Y dudo que Oculus no este pendiente del tema . Sony llego a comentar algo del eye traking en la presentacion de Morpheus .

-

"Jonelo"Si Sony consiguese el eye tracking y el foveated rendering y OR no lo trajese , partía por la mitad a Oculus . La ventaja de tener eso es tremenda . Imaginaros Oculus con su pantalla 2,5k a 95 Hz y a Sony con un cacharro a la misma resolucion pero que pide 4 o 5 veces menos maquina . O peor , un producto incluso de mas resolucion y pidiendo una maquina 3 veces inferior a la que pide el OR para correr un juego con la misma calidad . Sony o otro fabricante . Ese HMD rompe el mercado si el precio es parecido .

Incluso el foveated rendering, si disminuye el el ancho de banda necesario, podria dar pie a un modelo inalambrico a alta resolucion . Por todo esto pienso que el eye traking es un punto clave del futuro de estos HMD . Y dudo que Oculus no este pendiente del tema . Sony llego a comentar algo del eye traking en la presentacion de Morpheus .Aún así habría que ver cómo de posible es incluir esta tecnología en un hmd a dia de hoy, y aun así mantener el coste relativamente bajo. De cualquier manera si no es en las primeras remesas de HMDs, esto tendrá que llegar en algún momento para cuando nos lleguen las pantallas 4k y superiores.

I7 6700K / MSI 1070 Gaming X / MSI Z170 Gaming M5 / 16GB RAM DDR4 3000Mhz / Aerocool X-Strike 800W Gold

-

17 May 2013 19:12

Mensajes: 4244

Ubicación: Oviedo - Madrid - Castellon

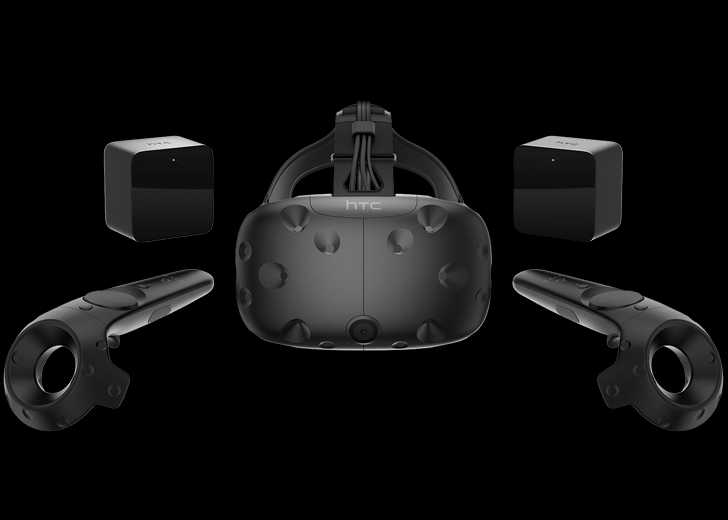

Visores

Valve Index Oculus Quest 2

Oculus Quest 2

"NoxWings"

"Jonelo"Si Sony consiguese el eye tracking y el foveated rendering y OR no lo trajese , partía por la mitad a Oculus . La ventaja de tener eso es tremenda . Imaginaros Oculus con su pantalla 2,5k a 95 Hz y a Sony con un cacharro a la misma resolucion pero que pide 4 o 5 veces menos maquina . O peor , un producto incluso de mas resolucion y pidiendo una maquina 3 veces inferior a la que pide el OR para correr un juego con la misma calidad . Sony o otro fabricante . Ese HMD rompe el mercado si el precio es parecido .

Incluso el foveated rendering, si disminuye el el ancho de banda necesario, podria dar pie a un modelo inalambrico a alta resolucion . Por todo esto pienso que el eye traking es un punto clave del futuro de estos HMD . Y dudo que Oculus no este pendiente del tema . Sony llego a comentar algo del eye traking en la presentacion de Morpheus .

Aún así habría que ver cómo de posible es incluir esta tecnología en un hmd a dia de hoy, y aun así mantener el coste relativamente bajo. De cualquier manera si no es en las primeras remesas de HMDs, esto tendrá que llegar en algún momento para cuando nos lleguen las pantallas 4k y superiores.Espero que se centren en ganar dinero en el soft y no en el hard como hacen actualmente con la ps4 y que se lo apliquen al HMD.

pEacE

paZ

和平 -

Me surge la duda entonces de cuánto podría costar añadir esta tecnología y una estimación de tiempo.

-

La tecnologia basica aplicada a monitores esta llegando a un precio bastante bajo. Es algo que se esta investigando por mucha gente porque es muy interesante . Creo que por debajo de 100 hay dispositivos , incluso 50 euros. Pero no tienen baja latencia . Los de poca latencia son mas caros .

Pero para el OR no se como lo harian . He visto algun mod del OR con dos camaras para seguimiento del ojo , se ponian dentro del visor al lado de las lentes . Las camaras no eran muy caras, 30 o 40 dolares cada una .

-

"Jonelo"La tecnologia basica aplicada a monitores esta llegando a un precio bastante bajo. Es algo que se esta investigando por mucha gente porque es muy interesante . Creo que por debajo de 100 hay dispositivos , incluso 50 euros. Pero no tienen baja latencia . Los de poca latencia son mas caros .

Pero para el OR no se como lo harian . He visto algun mod del OR con dos camaras para seguimiento del ojo , se ponian dentro del visor al lado de las lentes . Las camaras no eran muy caras, 30 o 40 dolares cada una .La cuestión está además en el tamaño. No he buscado mucho de el tema, pero de un par que he visto de momento no son suficientemente pequeños como para meterlos dentro del rift/ morpheus.

I7 6700K / MSI 1070 Gaming X / MSI Z170 Gaming M5 / 16GB RAM DDR4 3000Mhz / Aerocool X-Strike 800W Gold

-

-

Yo creo que si tres o cuatro frikis han conseguido fusionar una camara en un rift y conseguir eye tracking ¿Que nos tendran preparando en los cuarteles generales de OR y Sony? Lo mas dificil no es la camara en si, sino el software para separar las capas de renderizado en distintos niveles de resolucion. Que tengo clarisimo que el seguimiento ocular va a estar tanto en el Cv1 como en el Morpheos, ¿Cuanta gente tiene un pc que mueva 95 fps con doble renderizado? Se que en este foro bastantes si lo teneis o estais pensado pillarlo. Pero no somos suficientes para que saquen 2.000 millones de dolares de beneficio. Todavia somos un multiverso muy pequeñito.

Su pérgola en Murcia y Alicante al mejor precio en www.pergomur.com

-

6 Ago 2013 03:26

Mensajes: 1899

Ubicación: Murcia

Visores

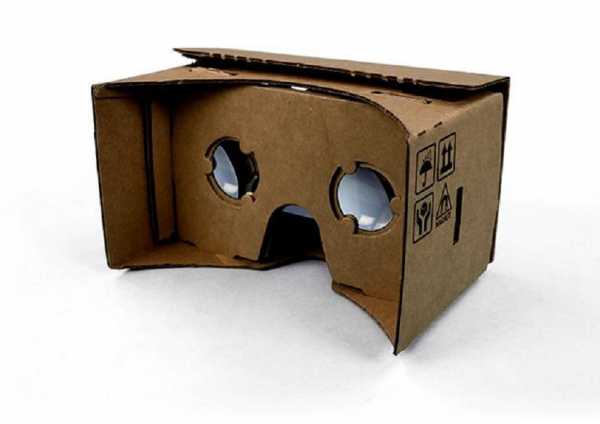

Oculus Rift Development Kit 2 Cardboard

Cardboard Oculus Rift

Oculus Rift Oculus Go

Oculus Go

Vamos a ver... que nos estamos montando una paja mental entre todos buena.

Lo de poder renderizar selectivamente en base a un seguimiento ocular son PURAS ESPECULACIONES. A nivel teórico incluso ya es complicado: habría que conseguir un seguimiento sin latencia (casi nada) y conseguir que el motor en cuestión procesase también todo este seguimiento sin inducir latencia, por no hablar de que la carga de procesado que quitas por un lado la sumas por otro al tener que calcular qué renderizar en base al seguimiento ocular....

Es decir, que todo esto son especulaciones que hemos ido montando por los foros y demás, pero no existe base científica alguna para todo esto. Es decir, hasta donde yo se nadie a demostrado que sea siquiera viable este planteamiento.

Así que no confundamos términos, conseguir seguimiento ocular pueden hacerlo cuatro frikis en su casa sin problema... pero conseguir renderizar selectivamente un juego en base a dicho seguimiento son ya palabras mayores.

-

"StandarK"Vamos a ver... que nos estamos montando una paja mental entre todos buena.

Lo de poder renderizar selectivamente en base a un seguimiento ocular son PURAS ESPECULACIONES. A nivel teórico incluso ya es complicado: habría que conseguir un seguimiento sin latencia (casi nada) y conseguir que el motor en cuestión procesase también todo este seguimiento sin inducir latencia, por no hablar de que la carga de procesado que quitas por un lado la sumas por otro al tener que calcular qué renderizar en base al seguimiento ocular....

Es decir, que todo esto son especulaciones que hemos ido montando por los foros y demás, pero no existe base científica alguna para todo esto. Es decir, hasta donde yo se nadie a demostrado que sea siquiera viable este planteamiento.

Así que no confundamos términos, conseguir seguimiento ocular pueden hacerlo cuatro frikis en su casa sin problema... pero conseguir renderizar selectivamente un juego en base a dicho seguimiento son ya palabras mayores.Si, casi todo pura especulación, pero como casi siempre que comentamos las posibilidades de futuras tecnologías .

El problema de la "sobrecarga" al tener que renderizar varias partes, a priori parece muchísimo menos de lo que te ahorras al renderizar menos pixels. Además una implementación en la parte de los motores creo que no sería tan extremadamente complicada y podría tener ciertas optimizaciones.

(Suponiendo N capas = 3 por ejemplo)Se pueden crear N viewport con N cámaras diferentes con un FOV diferente cada una y que se renderizan a los distintos niveles de calidad. La capa exterior es independiente el eye tracking ya que solo depende del frustum que veas en total. Las otras N-1 capas son todas concentricas. Seguro que podrían hacer optimizaciones como que cada cámara de un nivel interior se basase en el culling de la anterior cámara que la engloba. En teoría cuantas más capas mayor sobrecarga, pero si con 3 capas se nota tan poca diferencia como en el estudio de microsft[1] creo que serán más los beneficios que las pegas en cuanto a rendimiento.

[1] http://research.microsoft.com/en-us/um/redmond/projects/foveateddisplay/foveated_display_siggraphasia2012.mp4

El tema de la latencia ciertamente es un problema gordo y no estoy seguro de hasta que punto supondrá que sea posible o no su adopción para la RV.

EDITO: Perdón, acabo de darme cuenta que estoy asumiendo que el eyetracking es algo más que una cámara y que realiza él mismo el proceso de la imagen. Si, ciertamente esto tiene algo de sobrecarga, pero aun así también se procesan los led del dk2 o la bola de color del psmove (ambos a 60hz) y no parecen tener demasiado impacto. Es una pena que a valve no se les ocurrió probar este tema en sus estudios para decirnos como lo ven y que requisitos tendría esto para ser factible.

I7 6700K / MSI 1070 Gaming X / MSI Z170 Gaming M5 / 16GB RAM DDR4 3000Mhz / Aerocool X-Strike 800W Gold

-

Yo juraria que si hay un video la mar de hermoso de este trabajo de Microsoft haciendo foveated rendering .

research.microsoft.com/apps/vide ... ?id=173013

Ahora ya como se vaya a incorporar eso a los motores comerciales , no se .

-

"Jonelo"Imaginaros Oculus con su pantalla 2,5k a 95 Hz y a Sony con un cacharro a la misma resolucion pero que pide 4 o 5 veces menos maquina.

La PS4 está limitada por la salida HDMI 1.4, que si no me equivoco no podría enviar 2,5K a 95 Hz.

-

Colaborador

18 Ago 2013 16:58

Mensajes: 8753

Ubicación: En mi mundo virtual

Visores

Oculus Quest Oculus Quest 2

Oculus Quest 2 Air Link

Air Link Meta Quest 3

Meta Quest 3

El foveated rendering quizá aun quede algo lejos (aunque todo llegará) pero yo creo que a corto plazo no seria nada descabellado quedarse en un termino medio que ya comenté en otro hilo. Yo me he fijado en que cuando estoy con el Oculus, practicamente todo el tiempo mis ojos miran hacia el frente, y solo en pocas ocasiones miro de reojo a los lados o arriba y abajo. La imagen periferica me vale sobre todo para verla en la periferia de mi vision y darme esa sensacion de inmersion, pero no suelo mirarla directamente forzando los ojos hacia ella. Cuando vas con gafas de ver, es algo parecido, casi nunca fuerzas los ojos a los lados o arriba y abajo, sobre todo porque sobrepasas los cristales y no ves bien, pero esa parte de la imagen tiene que estar ahi, aunque todo el rato la percibas completamente desenfocada.

Con esto quiero decir que, aunque no sea la solucion ideal, si podria ser algo más realista y un buen apaño dar por sentado que miraremos casi siempre al frente, y disponer de 2 o 3 niveles de calidad prefijados que se rendericen siempre en la misma parte de la pantalla, el nivel más detallado, con mayor numero de poligonos, texturas de más calidad y más filtros en la zona central, y conforme nos acercamos a la periferia, una version de la imagen con menos poligonos, menos filtros y texturas más simples.... no se la dificultad técnica que tendrá esto que digo pero seguro que menor que una renderización por zonas dinamicas que dependan de hacia donde miremos.

Repito, no será lo ideal pero apuesto a que en circunstancias normales ni nos daremos cuenta que la imagen que está en nuestra visión periférica es de menor calidad que la que esta enfrente de nuestros ojos, y supongo que permitiría aprovechar mejor el rendimiento de las máquinas.

¿cómo lo veis?

Mi PC: AMD Ryzen 7 7700x, Nvidia RTX 4070 Ti, 32 Gb RAM DDR5 6000Mhz

-

"altair28"El foveated rendering quizá aun quede algo lejos (aunque todo llegará) pero yo creo que a corto plazo no seria nada descabellado quedarse en un termino medio que ya comenté en otro hilo. Yo me he fijado en que cuando estoy con el Oculus, practicamente todo el tiempo mis ojos miran hacia el frente, y solo en pocas ocasiones miro de reojo a los lados o arriba y abajo. La imagen periferica me vale sobre todo para verla en la periferia de mi vision y darme esa sensacion de inmersion, pero no suelo mirarla directamente forzando los ojos hacia ella. Cuando vas con gafas de ver, es algo parecido, casi nunca fuerzas los ojos a los lados o arriba y abajo, sobre todo porque sobrepasas los cristales y no ves bien, pero esa parte de la imagen tiene que estar ahi, aunque todo el rato la percibas completamente desenfocada.

Con esto quiero decir que, aunque no sea la solucion ideal, si podria ser algo más realista y un buen apaño dar por sentado que miraremos casi siempre al frente, y disponer de 2 o 3 niveles de calidad prefijados que se rendericen siempre en la misma parte de la pantalla, el nivel más detallado, con mayor numero de poligonos, texturas de más calidad y más filtros en la zona central, y conforme nos acercamos a la periferia, una version de la imagen con menos poligonos, menos filtros y texturas más simples.... no se la dificultad técnica que tendrá esto que digo pero seguro que menor que una renderización por zonas dinamicas que dependan de hacia donde miremos.

Repito, no será lo ideal pero apuesto a que en circunstancias normales ni nos daremos cuenta que la imagen que está en nuestra visión periférica es de menor calidad que la que esta enfrente de nuestros ojos, y supongo que permitiría aprovechar mejor el rendimiento de las máquinas.

¿cómo lo veis?Yo lo veo de puta madre

Si sumamos mantle a lo que dices, podremos disfrutar de las aicaciones sin un pepino de ordenador.

Yo voy a cambiar el pc en el 2015 asi que tengo mas tiempo de todos modos para ahorrar -

"altair28"El foveated rendering quizá aun quede algo lejos (aunque todo llegará) pero yo creo que a corto plazo no seria nada descabellado quedarse en un termino medio que ya comenté en otro hilo. Yo me he fijado en que cuando estoy con el Oculus, practicamente todo el tiempo mis ojos miran hacia el frente, y solo en pocas ocasiones miro de reojo a los lados o arriba y abajo. La imagen periferica me vale sobre todo para verla en la periferia de mi vision y darme esa sensacion de inmersion, pero no suelo mirarla directamente forzando los ojos hacia ella. Cuando vas con gafas de ver, es algo parecido, casi nunca fuerzas los ojos a los lados o arriba y abajo, sobre todo porque sobrepasas los cristales y no ves bien, pero esa parte de la imagen tiene que estar ahi, aunque todo el rato la percibas completamente desenfocada.

Con esto quiero decir que, aunque no sea la solucion ideal, si podria ser algo más realista y un buen apaño dar por sentado que miraremos casi siempre al frente, y disponer de 2 o 3 niveles de calidad prefijados que se rendericen siempre en la misma parte de la pantalla, el nivel más detallado, con mayor numero de poligonos, texturas de más calidad y más filtros en la zona central, y conforme nos acercamos a la periferia, una version de la imagen con menos poligonos, menos filtros y texturas más simples.... no se la dificultad técnica que tendrá esto que digo pero seguro que menor que una renderización por zonas dinamicas que dependan de hacia donde miremos.

Repito, no será lo ideal pero apuesto a que en circunstancias normales ni nos daremos cuenta que la imagen que está en nuestra visión periférica es de menor calidad que la que esta enfrente de nuestros ojos, y supongo que permitiría aprovechar mejor el rendimiento de las máquinas.

¿cómo lo veis?Como opción para los que no tengan un maquinon o para probar alguna demo/juego exigente puede tener sentido. En lugar de renderizar a maxima resolución en una zona tan pequeña, aumentar un poco el radio para evitar posible pequeños movimientos en el centro de la visión.

Como opción por defecto no lo veo ya que en cuanto mires a la visión periferica del hmd adiós presencia me parece, pero para probar cosillas y demos que no nos tiren podría estar bien.

I7 6700K / MSI 1070 Gaming X / MSI Z170 Gaming M5 / 16GB RAM DDR4 3000Mhz / Aerocool X-Strike 800W Gold

-

Colaborador

18 Ago 2013 16:58

Mensajes: 8753

Ubicación: En mi mundo virtual

Visores

Oculus Quest Oculus Quest 2

Oculus Quest 2 Air Link

Air Link Meta Quest 3

Meta Quest 3

"NoxWings"

"altair28"El foveated rendering quizá aun quede algo lejos (aunque todo llegará) pero yo creo que a corto plazo no seria nada descabellado quedarse en un termino medio que ya comenté en otro hilo. Yo me he fijado en que cuando estoy con el Oculus, practicamente todo el tiempo mis ojos miran hacia el frente, y solo en pocas ocasiones miro de reojo a los lados o arriba y abajo. La imagen periferica me vale sobre todo para verla en la periferia de mi vision y darme esa sensacion de inmersion, pero no suelo mirarla directamente forzando los ojos hacia ella. Cuando vas con gafas de ver, es algo parecido, casi nunca fuerzas los ojos a los lados o arriba y abajo, sobre todo porque sobrepasas los cristales y no ves bien, pero esa parte de la imagen tiene que estar ahi, aunque todo el rato la percibas completamente desenfocada.

Con esto quiero decir que, aunque no sea la solucion ideal, si podria ser algo más realista y un buen apaño dar por sentado que miraremos casi siempre al frente, y disponer de 2 o 3 niveles de calidad prefijados que se rendericen siempre en la misma parte de la pantalla, el nivel más detallado, con mayor numero de poligonos, texturas de más calidad y más filtros en la zona central, y conforme nos acercamos a la periferia, una version de la imagen con menos poligonos, menos filtros y texturas más simples.... no se la dificultad técnica que tendrá esto que digo pero seguro que menor que una renderización por zonas dinamicas que dependan de hacia donde miremos.

Repito, no será lo ideal pero apuesto a que en circunstancias normales ni nos daremos cuenta que la imagen que está en nuestra visión periférica es de menor calidad que la que esta enfrente de nuestros ojos, y supongo que permitiría aprovechar mejor el rendimiento de las máquinas.

¿cómo lo veis?

Como opción para los que no tengan un maquinon o para probar alguna demo/juego exigente puede tener sentido. En lugar de renderizar a maxima resolución en una zona tan pequeña, aumentar un poco el radio para evitar posible pequeños movimientos en el centro de la visión.

Como opción por defecto no lo veo ya que en cuanto mires a la visión periferica del hmd adiós presencia me parece, pero para probar cosillas y demos que no nos tiren podría estar bien.Hombre, precisamente a la presencia no creo que afectara para nada. Yo cuando voy con gafas mi vision periferica la veo con muchisima menos calidad que la central, completamente borrosa, y la parte central de mi vision la veo nitida, y no me afecta para nada a la presencia, asi que en realidad virtual no se por qué habría de ser distinto.. Ya digo que no es lo ideal pero como solucion intermedia para mejorar el rendimiento yo creo que podria estar muy bien y es muy probable que ni lo notaramos. Ahora, quien tenga una máquina que pueda renderizar todo a tope sin eso, pues logicamente no lo necesita, pero valdria para aumentar el numero de personas que podrian tirar de las cosas sin renunciar al menos a la calidad de la parte mas importante del area de vision.

Mi PC: AMD Ryzen 7 7700x, Nvidia RTX 4070 Ti, 32 Gb RAM DDR5 6000Mhz

-

"Juanlo"

"Jonelo"Imaginaros Oculus con su pantalla 2,5k a 95 Hz y a Sony con un cacharro a la misma resolucion pero que pide 4 o 5 veces menos maquina.

La PS4 está limitada por la salida HDMI 1.4, que si no me equivoco no podría enviar 2,5K a 95 Hz.Bueno, podrian sacar un nuevo modelo o quizas actualizar ? a 2.0 , no se si es posible pero creo que comentaron algo . En todo caso no se si tambien cambia el ancho de banda necesario al usar foveated rendering . Ademas no hablo en concreto de algo para PS4, creo que un modelo asi entraria en la batalla global de la RV que parece que va ser masiva , no solo en la PS4 .Pero mencionaba a Sony por que tiene un proyecto conocido , puede ser Microsoft o quien quiera entrar en la RV .

-

"altair28"

Hombre, precisamente a la presencia no creo que afectara para nada. Yo cuando voy con gafas mi vision periferica la veo con muchisima menos calidad que la central, completamente borrosa, y la parte central de mi vision la veo nitida, y no me afecta para nada a la presencia, asi que en realidad virtual no se por qué habría de ser distinto.. Ya digo que no es lo ideal pero como solucion intermedia para mejorar el rendimiento yo creo que podria estar muy bien y es muy probable que ni lo notaramos. Ahora, quien tenga una máquina que pueda renderizar todo a tope sin eso, pues logicamente no lo necesita, pero valdria para aumentar el numero de personas que podrian tirar de las cosas sin renunciar al menos a la calidad de la parte mas importante del area de vision.A lo que me refiero es que haciendo eso en cuanto te sales de la norma de mirar al centro y desvias la mirada hacia un lado, lo notarás raro por que no verás con la resolución correcta y estará borroso.

I7 6700K / MSI 1070 Gaming X / MSI Z170 Gaming M5 / 16GB RAM DDR4 3000Mhz / Aerocool X-Strike 800W Gold