La IA se impone al Metaverso

25 ABR 2024 13:00

La presentación del balance económico de Meta del primer trimestre nos deja muchas cifras de millones de dólares, pero también varias declaraciones y discursos sobre el futuro de la compañía, donde es muy difícil encontrar la que fue la palabra clave de hace unos pocos años: Metaverso.

Si Facebook tuviera que cambiar de nombre hoy, el escogido no sería Meta

Más de 50 veces se menciona la Inteligencia Artificial en el discurso de Mark Zuckerberg ante los accionistas, en la ronda de preguntas de estos y en las respuestas de los responsables financieros de la compañía.

El dispositivo Meta Quest aparece 6 veces, tres las gafas Ray-Ban Meta (potenciadas con IA) y 5 el modelo de IA Llama. El recién presentado Meta Horizon OS, la noticia "bomba" de la semana, una sola vez. Más de medio centenar de referencias a la IA frente solo a 4 al Metaverso, palabra de fama efímera, omnipresente en 2021 y parte de 2022, casi olvidada hoy.

Aunque en los planes de Meta el desarrollo de dispositivos XR siga siendo importante, cada vez está más claro que las inversiones dentro de Reality Labs están basculando del Metaverso a la Inteligencia Artificial. Nunca fue verdad eso de que "Facebook pierde cada trimestre 4 mil millones en el metaverso", y ahora menos que nunca.

Las acciones de Meta han bajado pese al anuncio de buenos resultados en el primer trimestre del año, y en toda la prensa económica se da la misma razón: los inversores se han asustado al darse a conocer que la compañía ha decidido aumentar sus inversiones hasta los 40 mil millones de dólares en 2024, 3 mil millones más de gasto de lo previsto, para reforzar su apuesta por la IA.

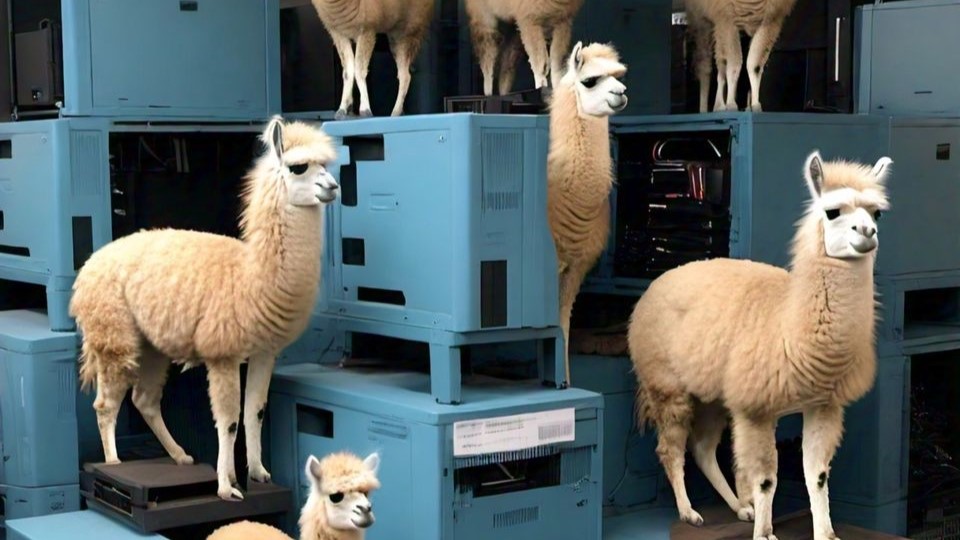

La cuenta de Facebook de Mark Zuckerberg se ilustra con esta imagen

Si ya había dudas sobre la rentabilidad de gastar millones de dólares en dispositivos XR y desconfianza en la promesa del que el Metaverso iba a empezar a dar beneficios en 2030, ¿cuándo serán económicamente rentables los modelos de inteligencia artificial de Meta? ¿Será la IA otro espejismo aunque a este barco se hayan subido todas las grandes compañías tecnológicas?

Los ingresos totales de Meta en el primer trimestre de este año fueron de 36.500 millones de dólares, un aumento del 27% con respecto a los resultados de hace un año, pero los gastos totales en Q1 2024 fueron de 22.600 millones de dólares, un 6 % más que el año pasado.

¿Hasta cuándo podrá Meta quemar dinero, invertir lo que gana en otras divisiones (Family Apps) en IA y Metaverso (Reality Labs)?

Y en cuanto a lo que los rovianos nos interesa, la realidad virtual, aumentada y mixta, ¿invertir en 2024 y 2025 más en IA significará hacerlo menos en XR? A veces da la sensación de que la película de ciencia-ficción que se vaya a hacer real en un futuro sea Terminator y no Ready Player One.

Dzbelio

Visores

#21 » Respuesta a cercata #20 Hoy 12:33

Conoces algún modelo tio que permita introducirle una base de datos (de historias) para que luego puedas sacarle matchs de esas historias?? me refiero. Imagínate que tienes 300 historias paranormales. Se las cargas, "evidentemente ocupan una barbaridad" y le preguntas sobre en cuántas historias por ejemplo el personaje es un chico..

Hay tantos modelos preentrenados que uno se pierde ya y no parece funcionarme ninguno bien. La IA alucina pepinillos. Tengo un buen equipo por lo que puedo cargar modelos tochos. 5950x 64 de ram y 4090. te lo agradecería si sabes algo.

Un saludo tron.

cercata

Visores

#22 » Respuesta a Dzbelio #21 Hoy 14:52

Eso mas que del modelo en sí, depende de los vectores que se generan para el RAG.

Por lo que cuentas, has probado lo de LocalDocs de GTP4ALL con varios modelos, y no está dando buenos resultados, no ?

De momento GPT4ALL parece que solo soporta SBERT.

Eso no se puede conseguir con RAG, para eso tendrias que hacer fine tuning del modelo con tus historias.

RAG lo que hace es dividir tus documentos en trocitos pequeños (256 caracteres en GPT4All), y luego ver si lo que pides encaja con alguno de esos trozos pequeños, y si encaja, ademas del prompt que le has metido, mete ese trozo en el promt. Bueno, puede meter varios trozos, por defecto GPT4ALL mete hasta 3 trozos.

Resumiendo, las preguntas que le hagas han de encontrar la respuesta en un numero pequeño de trozos del documento, nada de hacer calculos que impliquen todos los documentos.

Otra opcion sería usar un modelo que tenga un contexto gigante, y que las 300 historias quepan como prompt. Gemini Pro debe de tener 1M de contexto, pero modelos OpenSource no se si hay que soporten tanto. Y en caso de que lo soporten, habría que ver cuanta memoria ocupa el contexto, que habria que sumarselo a la del modelo. 64GB en temas de IA no es tanto.